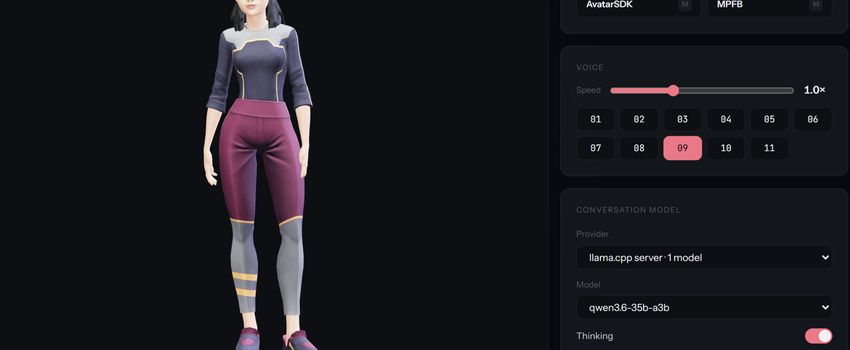

Автор считает, что пора собирать себе домашнего HAL’а на новых локальных моделях вроде Gemma4 или Qwen 3.6. Сейчас даже на обычной видеокарте можно запустить нормального мультимодального ассистента, который и жестикулирует, и лицо распознает, и умный дом крутит, и болтает без всяких облачных подписок - жрет только твое электричество.

Автор использует современные локальные модели, связку speech-to-text (Whisper/Moonshine) и text-to-speech (Kokoro), систему жестов и мимики, управляемую через вызовы инструментов LLM. Проект интегрируется с Home Assistant, поиском SearXNG, векторной базой Qdrant для памяти и распознаванием лиц.

В итоге автор запилил болванчика с анимацией, локальной википедией, поиском и автономными задачами. И он реально работает, правда, пока хватает контекста