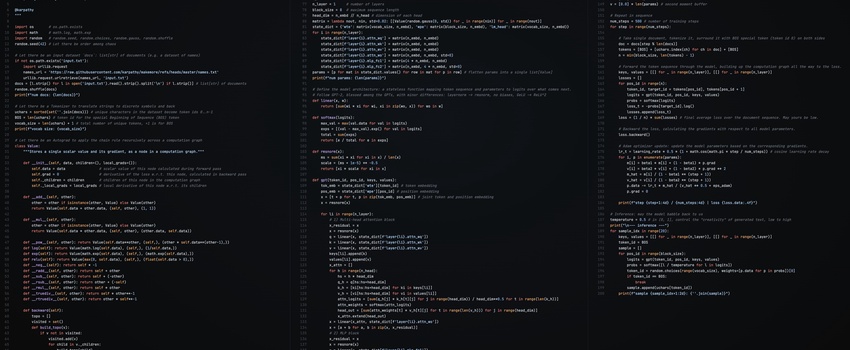

В статье Андрей Карпати показывает microgpt. Это минималистичная реализация GPT всего в 200 строках чистого Python без каких-либо зависимостей.

Автор шаг за шагом демонстрирует полный алгоритмический процесс обучения и инференса языковой модели: от токенизации набора данных из 32 000 имен до создания собственного движка автоматического дифференцирования, реализации архитектуры Transformer с механизмом внимания и MLP-блоками, а также оптимизатора Adam. Несмотря на крошечный размер, проект охватывает все ключевые концепции - эмбеддинги, residual-связи, KV-кеш, softmax и семплирование

Сложно, но в месте с каким нить курсом по GPT можно разобраться и потренироваться